2024. 11. 27. 09:42ㆍ컴퓨터비전&AI

<1장 인간 지능을 흉내 내는 인공지능 >

1. 미래 자율주행 예상모습 : 주변차와 통신하며 밀접주행

2. 규칙 기반 방법론 vs 기계학습 방법론

규칙 기반 : 사람이 사용하는 규칙 수집하여 프로그래밍 (규칙 위반하는 샘플 발생)

기계학습 : 충분한 데이터 수집 후 기계학습 모델링 (데이터 주도)

<3장 기계 학습과 인식 >

인공지능 > 기계학습 > 신경망 > 딥러닝

1. iris데이터셋읽기

2. 기계학습에서 데이터셋의 표현

특징베타: x로 표기, 레이블: 0,1,2,c-1 또는 원핫 코드 사용.

2. 기계학습 적용 : 모델링과 예측 (svm)

09행 : SVM 분류기 모델 SVC 클래스의 객체 생성해 s에 저장

10행 : 객체 s의 fit 함수는 훈련 집합 가지고 학습수행

13행 : 객체 s의 predict 함수는 테스트 집합을 가지고 예측 수행

3. 훈련집합 vs 테스트 집합

훈련 집합 : 기계학습 모델 학습하는데 쓰는 데이터, 특징 벡터와 레이블 정보 모두 제공

테스트 집합 : 학습 마친 모델의 성능 측정하는데 쓰는

- 데이터 예측: 특징벡터 정보만 제공

- 정확률 측정: 레이블 정보사용

4. 규칙기반 vs 고전적 기계학습 vs 딥러닝

규칙기반 : 분류규칙 사람이 구현

기계학습 : 규칙만드는 일은 기계학습 모델을 이용

딥러닝 : 특징 추출과 분류를 동시에 최적화 ( 단점 : 동작원리를 모름 )

5. 특징 공간에서 데이터 분포

-특징이 4개이므로 4차원 특징 공간 형성

-차원 하나 제외하고 3차원 공간에 데이터 분포

6. 특징 추출과 표현

데이터 수집 -> 특징추출(딥러닝은 생략) -> 모델링 -> 예측

7. 특징분별력

8. 특징값 종류

- 수치형 특징

범주형 특징(원핫코드)

9. 혼동 행렬과 성능 측정기준

10. 교차검증

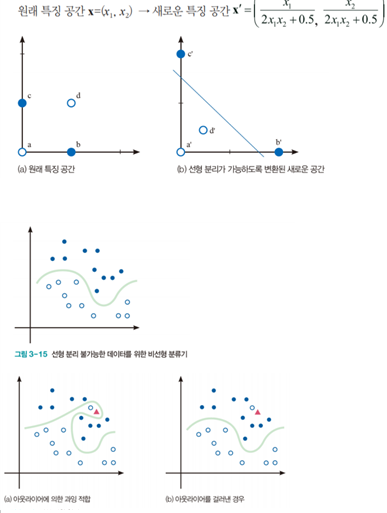

11. 특징 공간 분할하는 결정 경계

유리한 특징공간으로 여러 차례 변환

12. SVM의 원리

SVM은 여백 최대화

커널트릭 이용하여 비선형 분류기로 확장

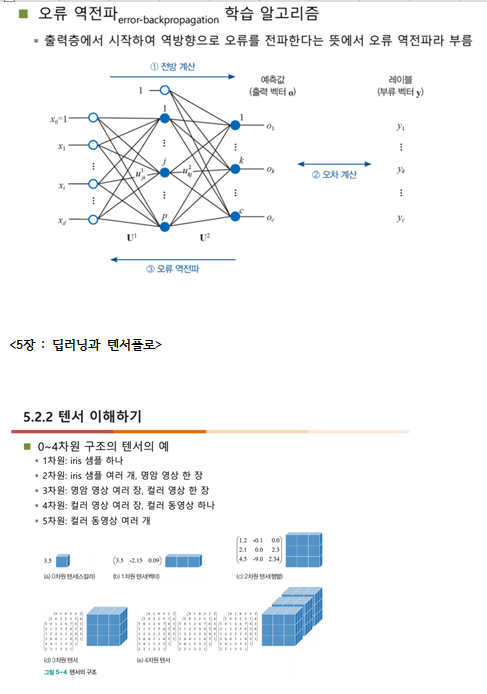

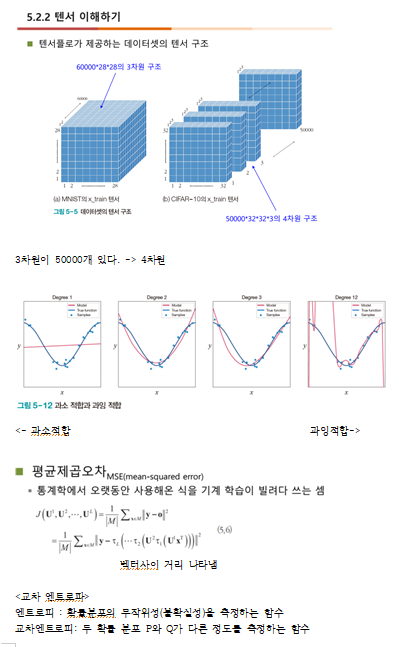

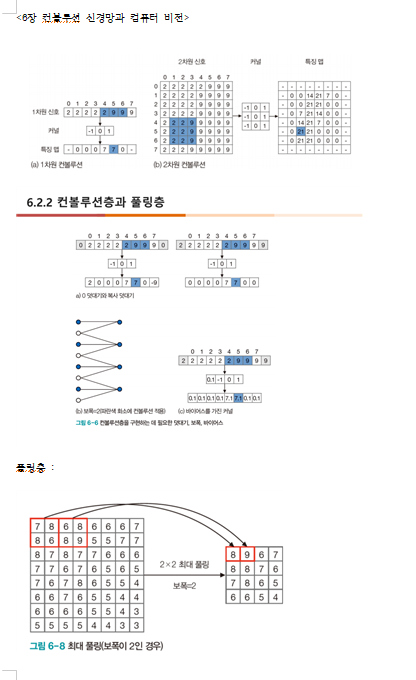

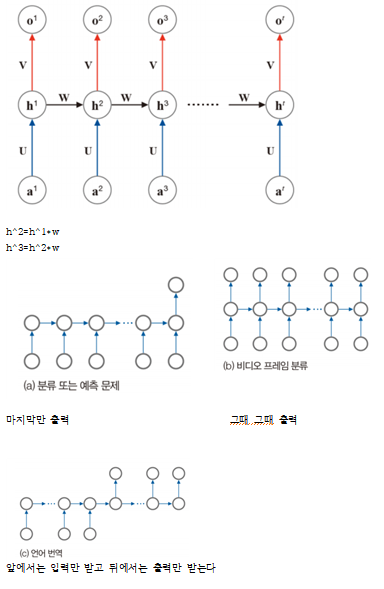

<4장 신경망 구축>

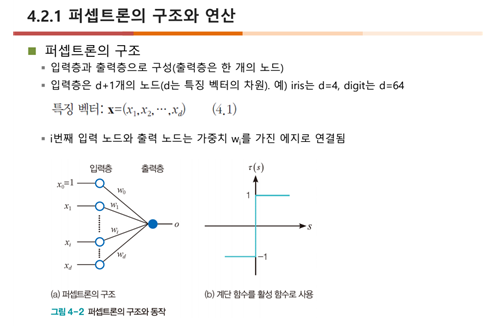

1. 퍼셉트론의 구조와 연산

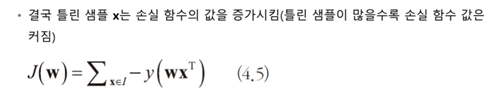

2. 스토캐스틱 경사 하강법

기계 학습은 스토캐스틱 경사 하강법으로 확장하여 사용

-배치모드 vs 패턴모드

배치모드 : 틀린 샘플 한번에 모은 다음 한번에 매개변수 갱신

패턴모드 : 화소 별 레이블이 지정한 물체 해당하는지 따지는 손실함수

(딥러닝은 주로 미니배치 사용 -> 패턴모드와 배치모드의 중간)

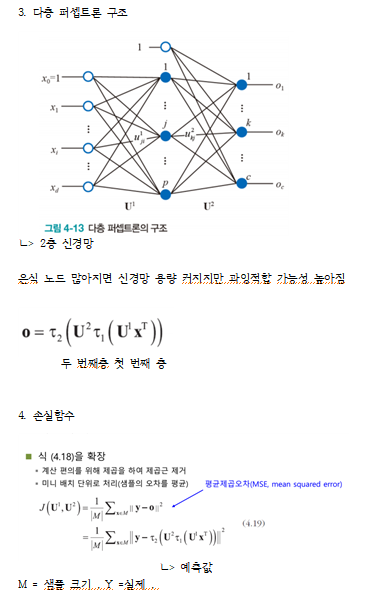

z1,z2공간 병렬 반환하고, 다시 퍼셉트론 => 다층 퍼셉트론

임시공간 층 = 은닉층 , 임시공간 = 은닉공간 = 잠복공간

원핫코드의 문제점과 해결책

사전 크기가 크면 원핫코드는 희소벡터가 되어 메모리 낭비

(하나만 1이고 나머지 다 0 이라서)

단어사이의 연관관계를 반영하지 못함

'컴퓨터비전&AI' 카테고리의 다른 글

| [AI 과제] 회귀 및 분류 모델을 통한 데이터 분석 및 시각화 (0) | 2024.11.27 |

|---|---|

| [AI 과제] 농구 선수 데이터셋 학습을 통해 포지션을 예측하는 모델, 크롤링 (3) | 2024.11.27 |

| [AI 배울랑교] 2. 초연결 (2) | 2024.11.27 |

| [논문 리뷰] Pointing Gesture-based Large Display Interface with Automatic Display-Camera Calibration (1) | 2024.11.09 |

| [HD Map_1] HD Map과 SD Map 차이 (2) | 2024.10.31 |